Host je eigen ChatGPT: werken met OpenWebUI

/

Host je eigen ChatGPT: werken met OpenWebUI

Generatieve AI-tools zoals ChatGPT zijn ondertussen ingeburgerd in veel organisaties. Ze helpen bij het schrijven van teksten, het analyseren van documenten of het beantwoorden van vragen. Toch werken de meeste van deze systemen volledig in de cloud. Dat betekent dat je afhankelijk bent van externe providers, dat data vaak buiten je organisatie wordt verwerkt en dat je werkt met een abonnementsmodel.

Voor sommige toepassingen is dat perfect. Maar er bestaat ook een alternatief: lokale AI-systemen.

In deze blogpost bekijken we hoe je met OpenWebUI een eigen AI-assistent kan draaien op je eigen computer of binnen je organisatie. Het doel is niet om een volledig technische handleiding te geven, maar om te tonen wat het concept inhoudt, wanneer het nuttig is en hoe de basisarchitectuur werkt.

Main section

Kerngegevens

/

OpenWebUI als interface voor lokale taalmodellen

/

Ollama voor het lokaal draaien van open-source LLM’s

/

Interessant voor privacygevoelige of interne data

Cloud AI versus lokale AI

De meeste AI-tools vandaag werken volgens een cloudmodel. Je stuurt een vraag naar een externe server en het model genereert daar een antwoord.

Dit heeft duidelijke voordelen: krachtige modellen, geen installatie en een eenvoudige start.

Maar voor sommige toepassingen zijn er ook nadelen:

- data verlaat je toestel

- afhankelijkheid van externe providers

- API-kosten bij intensief gebruik

Bij lokale AI draait het model rechtstreeks op je eigen computer of binnen je eigen organisatie.

Hierdoor krijg je onder andere:

- volledige controle over je data

- geen kosten per API-aanroep

- de mogelijkheid om offline te werken

- betere integratie met interne systemen

Voor organisaties met gevoelige data of interne documentatie kan dit een groot voordeel zijn.

OpenWebUI biedt een gebruiksvriendelijke interface om lokale taalmodellen te gebruiken.

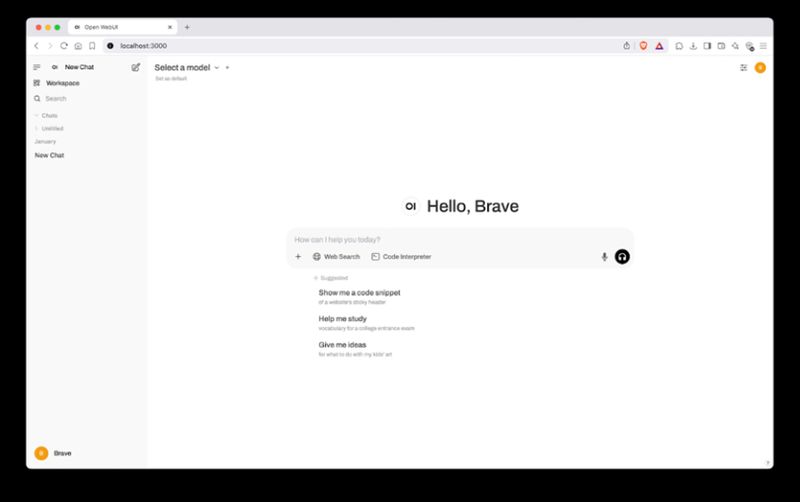

Wat is OpenWebUI?

OpenWebUI is een open-source webinterface voor AI-modellen . Het geeft gebruikers een chatomgeving die sterk lijkt op ChatGPT, maar waarbij de onderliggende modellen lokaal draaien.

Binnen OpenWebUI kan je onder andere:

- verschillende taalmodellen gebruiken

- documenten analyseren

- externe API’s koppelen

- experimenteren met modelparameters

- extra functies zoals web search toevoegen

Omdat het open source is, groeit de community snel en verschijnen er regelmatig nieuwe uitbreidingen.

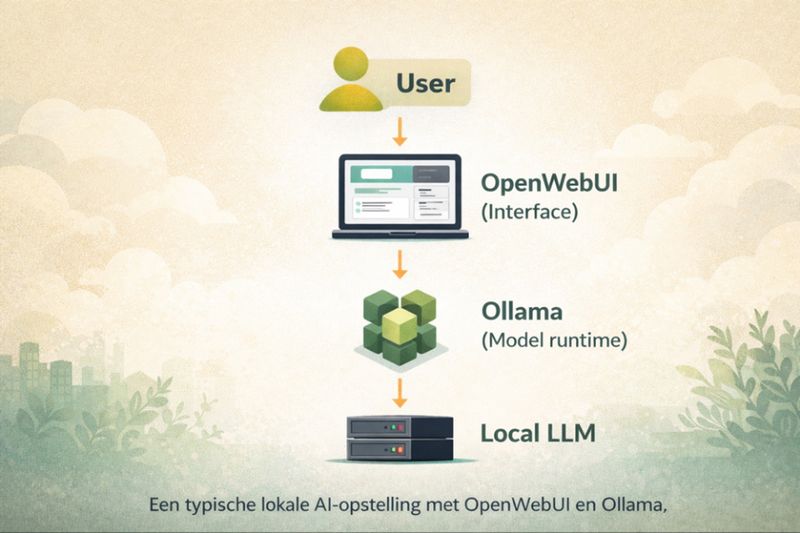

De rol van Ollama

Om lokale modellen effectief te draaien is er ook een model runtime nodig. Een populaire tool hiervoor is Ollama.

Ollama maakt het eenvoudig om open-source taalmodellen te downloaden en lokaal uit te voeren.

Voorbeelden van modellen zijn:

- Llama-modellen

- Qwen-modellen

- andere modellen uit repositories zoals HuggingFace

Deze modellen kunnen variëren in grootte. Kleinere modellen werken op laptops, terwijl grotere modellen meer geheugen of een GPU vereisen.

OpenWebUI gebruikt deze modellen vervolgens als AI-engine achter de chatinterface .

Een concreet use-case: interne AI-assistent

Een veelgebruikte toepassing van lokale AI is een interne bedrijfsassistent .

Organisaties beschikken vaak over grote hoeveelheden interne documenten:

- technische documentatie

- contracten

- HR-richtlijnen

- beleidsdocumenten

Met technieken zoals Retrieval-Augmented Generation (RAG) kan een lokaal model deze documenten gebruiken als kennisbron.

In plaats van handmatig door mappen te zoeken, kunnen medewerkers eenvoudig vragen stellen aan een AI-assistent.

Omdat het systeem lokaal draait, blijft alle informatie binnen de organisatie .

Bottom section

De volgende stap

Met tools zoals OpenWebUI wordt het steeds eenvoudiger om zelf AI-systemen op te zetten en te beheren .

Lokale AI geeft organisaties meer controle over hun data en infrastructuur, en kan een interessante aanvulling zijn op bestaande cloudoplossingen.

Binnen het AI Lab blijven we experimenteren met zowel lokale als cloudgebaseerde AI-opstellingen. In toekomstige workshops en blogposts gaan we verder in op meer geavanceerde toepassingen zoals RAG-systemen, agent workflows en integraties met interne data.

Contributors

Authors

/

Arne De Vos, Intern

/

Jens Krijgsman, Automation & AI researcher, Teamlead

Want to know more about our team?

Visit the team page